¿El contenido de IA está ayudando o perjudicando a su sitio web?

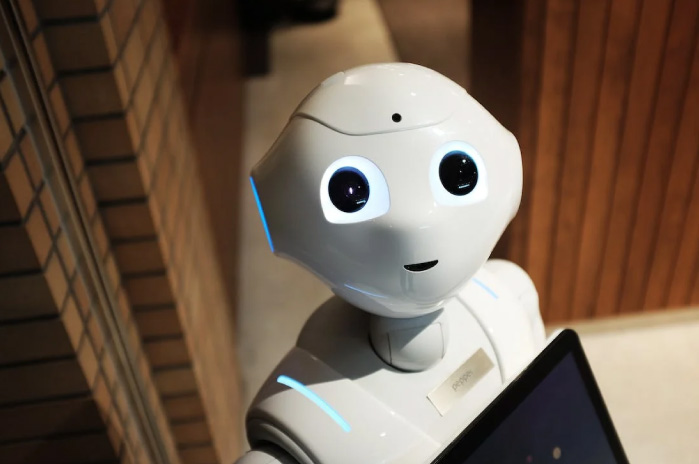

Están apareciendo nuevas herramientas de contenido de IA a izquierda y derecha. ¡Estas herramientas pueden ayudarlo a escribir una publicación social o una publicación de blog completa, responder cualquier pregunta o incluso crear una imagen nueva! Esto es genial y útil cuando solo tienes un poco de tiempo o necesitas más inspiración. Pero la gran pregunta es, ¿las herramientas de IA realmente nos están ayudando? ¿Deberíamos usarlos para crear nuestro contenido? Esta publicación de blog discutirá el contenido de IA y por qué debemos tener en cuenta cómo lo usamos.

El contenido generado por Inteligencia Artificial se está disparando

AI, o Inteligencia Artificial, se refiere a los sistemas que realizan tareas que normalmente requieren inteligencia humana, como la percepción, el aprendizaje, el razonamiento, la resolución de problemas y la toma de decisiones. Y ahora mismo, hay una explosión de herramientas de IA en todas las formas y tamaños.

La adopción generalizada de generadores de contenido impulsados por IA hace que sea más fácil que nunca producir contenido rápidamente a escala. Con solo unos pocos clics, cualquiera puede generar un artículo genérico poco entusiasta que una persona debe editar para que se ajuste al tono de su negocio y lo convierta en un hecho.

Es fácil dejarse llevar por toda la emoción y generar mucho contenido con estas nuevas y brillantes herramientas. Sin embargo, hay algo que no podemos ni debemos ignorar cuando usamos estas IA. Puede que no le sorprenda que el uso de una herramienta de inteligencia artificial para crear su contenido resulte en un contenido similar al de otros. Por un lado, esto no es bueno para tu SEO.

También resulta en un problema mucho mayor que nos afecta a todos. Este contenido a menudo no es diverso e inclusivo en absoluto. Está creado por IA que fueron entrenadas con contenido sesgado. Y este contenido suele estar escrito por el mismo tipo de persona. ¡Vamos a sumergirnos en esto y descubrir qué se puede hacer!

El uso de herramientas de IA creará una cámara de eco

Una de las principales preocupaciones con el contenido generado por IA es la falta de originalidad y autenticidad. Si bien los algoritmos pueden imitar el estilo y el tono del contenido existente, no pueden reemplazar la creatividad y la originalidad de las personas reales.

El contenido generado por IA a menudo carece de matices, profundidad y originalidad, lo que puede dañar la credibilidad y la reputación de una marca. Además, el uso de contenido generado por IA puede perpetuar estereotipos, sesgos y prácticas excluyentes, ya que los algoritmos tienden a replicar patrones y preferencias existentes.

Debido a que las herramientas de contenido de IA facilitan tanto la creación de contenido, ahora es más fácil que nunca producir el mismo contenido que todos los demás. Y si todos usan la misma IA para crear contenido, nadie está creando contenido nuevo. De hecho, crearemos una cámara de eco sin nuevos pensamientos o ideas. Esto conduce a una visión estrecha y no inclusiva del mundo.

Relacionado con esto, Maggie Harrison de Futurism escribió un artículo interesante sobre ChatGPT como una máquina automatizada de explicación de personas. Tener solo este punto de vista del mundo, lejos de ser inclusivo, es perjudicial para la sociedad de muchas maneras. No tiene en cuenta la gran diversidad de personas y puntos de vista en nuestro mundo. Tampoco defiende a grupos de personas que a menudo han sido desatendidos y marginados en el pasado.

Los conjuntos de entrenamiento de IA tienen un sesgo

Los modelos de lenguaje grande (LLM) que impulsan a Google Bard, el asistente Bing de Microsoft y ChatGPT de OpenAI están capacitados en el contenido de Internet de hoy. Y aunque a la mayoría de la gente le gustaría creer que Internet es diverso e inclusivo, tiene algunos rincones muy cuestionables.

Deberíamos tratar de luchar por un mundo que sea mucho más inclusivo de lo que es hoy. Usar foros públicos en Internet para entrenar sus IA puede no ser la mejor idea. En los últimos años, esto ha llevado a que las IA se vuelvan racistas y parciales.

Algunos ejemplos

El uso de Internet de hoy para entrenar IA tiene múltiples problemas de inclusión. Esto significa que las propias IA se vuelven racistas, sexistas o capacitistas porque el contenido en el que están siendo entrenados es racista, sexista o capacitista. Veamos un par de ejemplos.

La debacle de contratación de IA de Amazon

Tomemos, por ejemplo, la IA de contratación de Amazon. Desarrollaron esta herramienta como el «santo grial» de la contratación para ayudarlos a encontrar a las personas adecuadas para el trabajo. Amazon usó diez años de currículums en su mayoría masculinos para entrenar a la IA. Por supuesto, esto es un reflejo de la industria tecnológica en general, pero también significa que la herramienta se volvió sexista.

Es posible que no hayan tenido la intención de crear una IA sexista, pero debido a que los datos que habían recibido estaban sesgados hacia más contrataciones de hombres, pensó que estaba haciendo lo correcto. La IA siempre estará sesgada si los datos que están usando para entrenar están sesgados.

La creación de imágenes también puede ser problemática

Otro ejemplo de que la IA se vuelve racista es la creación de imágenes de la IA. Si desea generar una imagen de una pareja romántica tomados de la mano, no es raro ver que todos los generadores devuelven predominantemente a personas blancas. En julio de 2021, Dall-E 2 actualizó su herramienta para “reflejar con mayor precisión la diversidad de la población mundial”. Desafortunadamente, todavía produce fotos que no son diversas. Solo mostraría personas de color cuando agregara la palabra «pobre» al aviso.

Esto no se limita solo a las personas de color; la comunidad LGBTQI+ también fue víctima de estas imágenes no inclusivas. Por supuesto, las herramientas pueden hacer ajustes a sus sistemas. Todavía tenemos un largo camino por recorrer para reflejar el mundo en el que estamos. Como Zoe Larkin (Levity) escribe en la publicación de blog sobre el sesgo de la IA: “Desafortunadamente, la IA no está a salvo de las tendencias del prejuicio humano. Puede ayudar a los humanos a tomar decisiones más imparciales, pero solo si trabajamos diligentemente para garantizar la equidad en los sistemas de IA”.

No te olvides de la edición humana.

Hasta cierto punto, es aceptable usar herramientas de IA como atajos. Hoy, sin embargo, los creadores de contenido los usan sin tener en cuenta los datos que alimentaron a las IA. Esto conduce al refuerzo y expansión de las cámaras de eco y contribuye a la creación de contenido similar y la producción de imágenes racistas y no inclusivas/diversas.

Como resultado, los creadores de contenido deben ser más conscientes de los datos y algoritmos utilizados por las herramientas de IA para garantizar que su contenido sea auténtico, diverso e inclusivo y no perpetúe estereotipos o prácticas excluyentes.

Una gran cantidad de contenido en línea no es representativo

La herramienta de contratación de Amazon y Dall-E 2 son algunos ejemplos de generadores de contenido de IA que se vuelven deshonestos. Y no es extraño que las herramientas de contenido de IA funcionen de la misma manera porque Internet está lleno de contenido escrito por hombres cis blancos mediocres de habla inglesa.

Por ejemplo, un estudio realizado por el Instituto de Internet de la Universidad de Oxford encontró que los editores (en su mayoría hombres) en la parte occidental del mundo hicieron la mayoría de las contribuciones a Wikipedia, creando una visión del mundo sesgada.

Incluso si esta es una parte de su público objetivo, no es la única audiencia. Las personas de todos los orígenes con todo tipo de experiencias actualmente representan solo un pequeño porcentaje de las voces que se escuchan.

Si queremos romper el ciclo de esta repetición continua del mismo contenido, debemos mejorar en la escritura y crear contenido más inclusivo. De esa manera, podemos entrenar a las IA del futuro en una Internet más inclusiva y diversa.

Haz que el contenido de hoy sea mejor para el futuro

Intenta no ser esa persona de la reunión que repite lo que dicen los demás. Produzca contenido en su voz y hágalo accesible a la audiencia más amplia posible. Todo esto contribuye a una mejor Internet para todos.

Comuníquese apropiadamente con la audiencia a la que está tratando de llegar. Cuando escribes de manera inclusiva, tú, amigo mío, estás ayudando a crear contenido que hará de Internet del futuro un lugar mejor.

Sea consciente de su propio sesgo

No son solo las IA las que tienen este sesgo; todos tenemos un sesgo inconsciente que estamos tratando de desaprender y evolucionar. Eso es lo que nos trajo aquí en primer lugar. Todos debemos mejorar para escribir contenido más inclusivo. Solo tomándonos el tiempo para escribir contenido inclusivo daremos forma a la Internet de hoy. Esto, a su vez, significa que podemos entrenar las herramientas de IA del futuro en un lenguaje más inclusivo y menos despectivo.

Esa es una gran responsabilidad, lo sabemos. Y esto no es algo que vaya a cambiar de la noche a la mañana; tomará tiempo. Sin duda nos equivocaremos. Pero, al hacer un esfuerzo ahora para crear contenido diverso e inclusivo, comenzaremos a rodar hacia un Internet mejor.

¿Entonces, qué podemos hacer?

Puede utilizar herramientas de IA como parte de su proceso de creación de contenido. Sin embargo, debe hacer una edición humana antes de presionar publicar. Sea crítico con el contenido que sale de la herramienta de IA. Asegúrate de hacer una verificación de hechos. Y haz los ajustes necesarios. No solo debe ajustar el tono de voz en su contenido, sino también verificar su diversidad e inclusión. Debe identificar cualquier contenido problemático. Mejórelo hasta un punto en el que cualquiera pueda relacionarse con él y se sienta cómodo con él.

Cómo hacer que tu contenido sea más inclusivo

Puede ser difícil saber por dónde empezar. Ahí es donde las herramientas pueden ayudarlo a encaminarse hacia una Internet más inclusiva y diversa. Por ejemplo, nuestro análisis de lenguaje inclusivo en Yoast SEO. Este nuevo análisis lo ayuda a detectar cuándo puede haber utilizado inconscientemente un término que no es inclusivo o que, de hecho, es racista, sexista o capaz.

Al igual que nuestro análisis de legibilidad, busca en su texto palabras de nuestra base de datos que sean racistas, sexistas, no inclusivas o despectivas. Le ayudará a tomar conciencia de esas palabras y frases no inclusivas. Obtendrá comentarios y alternativas adecuadas que pueden mejorar su contenido para garantizar que los visitantes del sitio se sientan atendidos. Con solo unos pequeños pasos en la dirección correcta, esperamos que todos podamos hacer del mundo y de la web un lugar más inclusivo y diverso para las generaciones futuras. Y para futuras IA.

Esta publicación apareció por primera vez en inglés en yoast.com en esta URL.